颠覆传统思路,AI时代如何抵抗数据投毒攻击

更新时间:2024年12月11日 阅读时长:约5分钟

AI原生应用正在迅速成为人工智能的下一个前沿领域。AI驱动的系统使用算法和模型来处理和合成数据、学习数据中的模式和依赖关系,并做出类似于人类推理的决策。伴随着AI带来的巨大机遇,也伴随着一系列风险和潜在的危害,这些都可能损害AI的可信度。

谷歌大脑研究科学家Nicholas Carlini在上海的一次会议上指出,修改0.1%的数据集就足以实现有效的数据投毒攻击。想象一下,智能聊天机器人喷出仇恨言论,被攻陷的电子邮件垃圾邮件过滤器允许恶意流量通过,或者自动驾驶汽车因数据篡改而做出严重误判,后果不堪设想。

什么是数据投毒? 数据投毒是一种通过向训练数据集中注入恶意数据,操纵模型行为的对抗性攻击,导致AI系统输出错误结果。

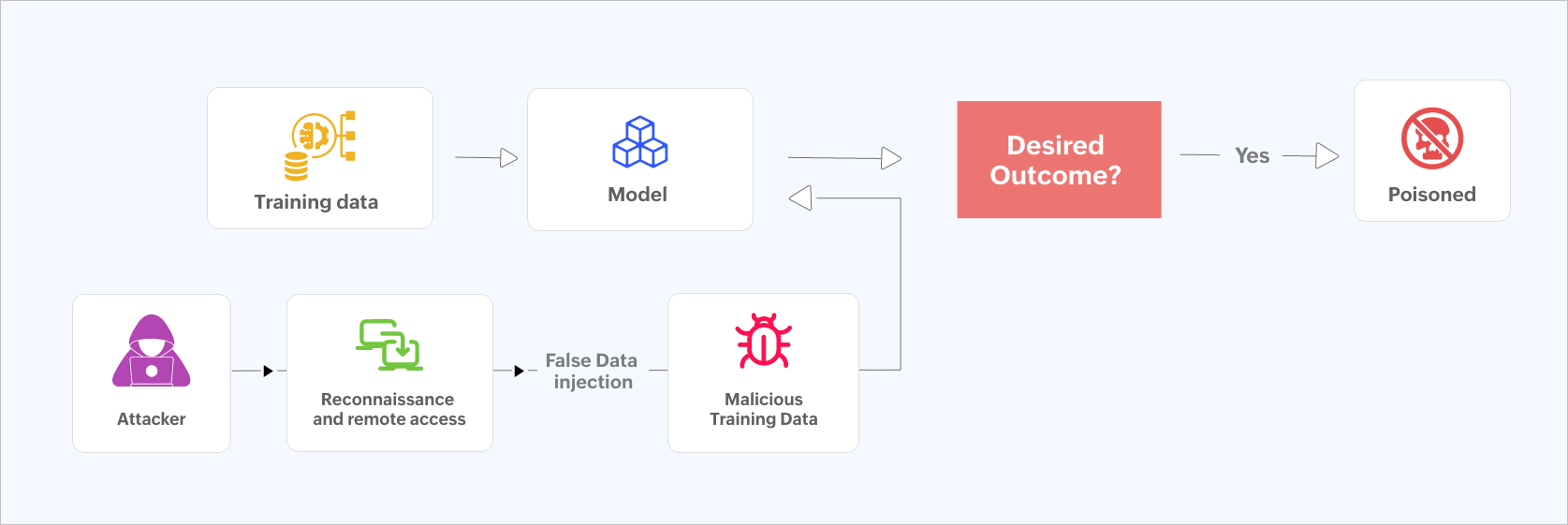

数据投毒攻击如何进行?

如果AI工具使用了错误的数据集进行训练,系统会将其视为有效输入,并将数据整合到系统规则中,攻击者可以利用这一点污染数据,危害整个系统。

数据投毒攻击的具体步骤包括:攻击者首先分析模型的漏洞,创建类似原始数据集的对抗性数据样本,并将恶意数据注入训练数据集,从而使模型生成错误的预测。训练后,攻击者可以利用模型的偏差达到恶意目的。

理想情况下,由授权工程师训练的机器学习模型应使用授权且可信的数据集。攻击者在此阶段的目标是确保即使有投毒数据被添加,模型也能继续正常工作,从而便于他们在未来引入更具威胁的数据集。

通过分析模型的决策和预测方式,攻击者识别模型的弱点,找到可以被操纵的潜在数据点。找到弱点后,他们创建与原始数据集相似的对抗性数据样本,这些样本一旦加入训练集,将导致模型生成错误预测。

攻击者可以直接将投毒数据注入训练数据集,或者通过破坏数据收集过程间接引入恶意数据。直接注入恶意数据的方法包括破坏数据库或数据服务器。

在投毒数据被注入后,模型会使用更新的数据集重新进行训练,其中包含恶意数据样本。

在模型成功被投毒后,它会部署到现实环境中,与新的数据集进行交互。利用模型的偏差行为,达到其恶意目的。

如何防范数据投毒? Log360 给出最新思路

防止恶意输入的一种方法是通过识别异常,这对计算机系统、网络和软件应用程序的安全性和完整性非常重要。ManageEngine Log360 是一款具有异常检测能力的统一安全信息与事件管理SIEM解决方案。

通过使用Log360,安全分析人员可以怎么做?

识别异常用户和实体行为,例如在不寻常的时间登录、过多的登录失败,以及来自不常用主机的文件删除。

通过对用户和实体的评分风险评估,获得对威胁的更大可见性。

通过数据定义语言(DDL)和数据操作语言(DML)审计报告识别对数据库的更改。

检查操作数据和性能的变化也很重要。许多情况下,原始训练数据——包括图像、音频文件和文本——会保留在云对象存储中,因为相较于本地存储解决方案,云存储提供了更经济、易于访问和可扩展的存储选项。借助集成了云访问安全代理(CASB)能力的统一安全信息与事件管理(SIEM)解决方案,安全分析人员可以:

1、增强对云事件的可见性。

2、促进云环境的身份监控。

3、获得云环境的威胁保护能力。

4、促进云环境的合规管理。

此外,为了实施这些攻击,攻击者需要了解模型的运作方式。他们需要强有力的访问控制机制。而Log360 包含一个复杂的关联引擎,可以实时组合网络中发生的各种事件,并确定其中是否存在潜在威胁。安全分析人员可以使用上述策略来避免此类攻击。

您是否在寻找保护组织敏感信息不被滥用的方法? ManageEngine Log360是一款全面的安全信息与事件管理(SIEM)解决方案,可以帮助您检测、优先处理、调查和应对安全威胁。

同时 Log360 有30天的免费试用时长,充分的解决您组织敏感信息泄露风险问题。